如果你最近在找 gpt-image-2 国内怎么用,大概率不是想看概念解释,而是已经准备拿它做公众号头图、活动海报、课程封面、商品配图或者 PPT 视觉稿了。对国内用户来说,问题通常不在“模型强不强”,而在“入口在哪里、怎么稳定用、哪个平台更适合日常工作流”。这篇文章就按实操顺序讲清楚:gpt-image-2 是什么、适合哪些任务、国内怎么开始、什么时候优先用 AIMirror GPT 中文站,什么时候用 chat.aicnbox.com 做备用。

先说结论。对于大多数中文用户,最省时间的方式不是折腾单一官方入口,而是把 AIMirror GPT 中文站 当主力工作台,把 chat.aicnbox.com 当备用入口。前者更适合把文案、提示词、图像生成和改图串成完整流程,后者更适合高峰期补位、轻量测试和结果对照。只要把这两个入口配合起来,gpt-image-2 国内使用 的门槛会低很多。

gpt-image-2 是什么

gpt-image-2 可以理解为一类面向图像生成与编辑的模型能力,它的重点不只是“画得像”,而是“更适合按任务出图”。过去很多绘图模型适合做风格图、概念图、氛围图,但一旦任务变成海报、封面、展示图、知识卡片、详情页配图,就容易出现构图失衡、主体不清、留白不足或者不方便继续改。gpt-image-2 这一代更值得关注的地方,就在于它更接近真实工作流。

对于内容团队、产品团队和个人创作者来说,这一点比单纯拼画质更重要。因为你最终要的不是一张“看起来不错”的图,而是一张能发出去、能叠标题、能放在页面里、能继续迭代的图。只要模型更适合任务型输出,你就更容易把它变成稳定工具,而不是一次性玩具。[^1][^2]

哪些人最适合用 gpt-image-2

第一类是内容运营和自媒体团队。他们最常做的是文章头图、活动海报、社媒卡片和课程封面,需求高频、节奏快、修改多。用 gpt-image-2 的关键价值,不是一次做出完美成品,而是在十几分钟内做出可继续修改的第一版,然后围绕真实场景快速迭代。

第二类是产品和市场团队。这类人经常要做落地页头图、宣传页视觉稿、PPT 配图和专题活动视觉。过去这些需求要么排队等设计,要么临时拼模板,现在如果目标是先验证方向、快速出方案,gpt-image-2 就会更高效。什么时候用?当你还在试主题、试卖点、试包装方向时最适合。怎么做?先让文本模型整理结构,再交给图像模型执行。做到什么程度?至少要让图能进入评审,而不是停留在草稿描述上。

第三类是中小商家和个人创作者。比如饮品店活动图、知识产品封面、培训海报、私域招募图、电商氛围图,这些任务不一定追求大品牌级精修,但非常重视出图速度和修改效率。只要你能说清图的用途、受众、风格和尺寸方向,gpt-image-2 就能明显缩短准备时间。

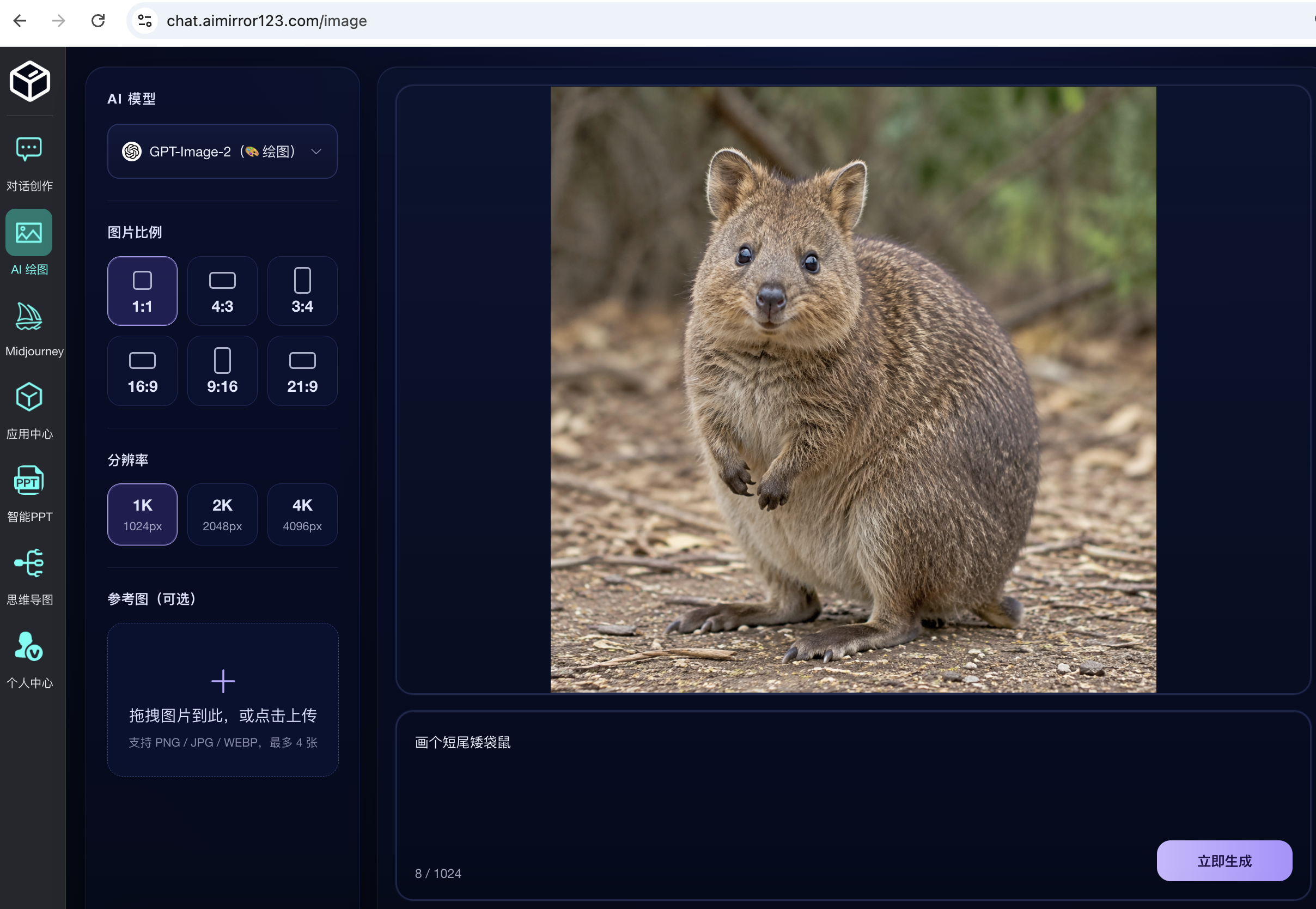

国内怎么用 gpt-image-2

对普通用户来说,最稳妥的方式是先用中文工作台跑通流程,再决定是否回到更原生的官方环境。这里我更建议把 AIMirror GPT 中文站 当主入口。原因很直接:它更适合中文用户日常工作,既能做图,也方便和 GPT、Claude、Gemini 这类文本模型一起协作。你可以先让模型帮你整理标题和卖点,再切到绘图模型出图,这样比单独找一个“只能画图”的入口更顺。

备用入口建议放在 chat.aicnbox.com。它更适合做轻量任务、快速测试和高峰期补位。为什么一定要有备用方案?因为一旦你把 AI 做图放进发文、投放或者活动节奏里,就不能接受入口波动导致完全停工。备用入口的价值,不是替代主入口,而是保证流程不断。

最适合先试的 4 个场景

如果你第一次测试 gpt-image-2,不建议一上来就做最复杂的长图或者满版海报。更高效的做法,是先拿最容易验证结果的任务测试模型稳定性。

1. 公众号头图

这是最适合起步的任务。因为目标明确,验证也简单。你只要看三件事:主题是不是一眼能懂、横向裁切后主体会不会被破坏、后续叠标题是否方便。如果这三点都成立,说明模型已经适合进入内容生产流程。

2. 活动海报

活动海报能直接测试模型的任务理解能力。因为你要的不只是画面好看,还要有行动感、主题感和信息层级。比较好的做法是把提示词写成“用途 + 人群 + 风格 + 留白区域”的结构,再根据第一版连续修改。备用方案是先用文本模型帮你整理主标题和三条卖点,再生成配图。复核方式是把图按真实比例放进海报版式里,看标题和背景会不会打架。

3. 小红书封面或社媒卡片

这类图对“快、稳、可复用”要求很高。什么时候用?当你需要连续出十几张同风格图片时。怎么做?固定视觉骨架,只替换主题和主元素。做到什么程度?至少要让同一账号下的图片风格统一,但又不会一眼看出是同一模板硬套。

4. PPT 配图和专题页头图

这类任务特别适合产品经理、运营经理和创业团队。因为你经常需要“和主题相关、但素材站找不到完全合适”的图。选择标准是统一风格、能叠文案、和页面结构相容。备用方案是先出一批风格稿,再挑最适合的方向做精修。复核方式是直接放进 PPT 或专题页头部,检查整套视觉是否统一。

新手上手流程:5 步就够

第一步,先写清用途,不要先堆风格词。比如“我要一张公众号教程头图”比“做一张高级感科技图”更容易出对结果。第二步,写清受众和风格方向,例如“面向普通中文用户,科技感但不要过于硬核”。第三步,先生成第一版,不要期待一步到位,先看方向是否正确。第四步,连续修改时一次只改一两个变量,比如主体位置、背景复杂度、色彩方向,这样更容易知道问题出在哪里。第五步,把成熟提示词模板保存下来,下次同类任务直接复用。

这套流程的核心不是炫技,而是可复用。什么时候说明你已经掌握了?当你下次做同类任务时,不需要从零开始想结构。怎么判断做到位?同类图能稳定在十到二十分钟内出到可用初稿,就已经有业务价值了。

可直接复用的提示词模板

下面这几条可以直接测试。建议先在 AIMirror GPT 中文站 跑一轮,再拿去 chat.aicnbox.com 做结果对照。

公众号头图模板:

请生成一张适合公众号文章头图的封面图,主题是“gpt-image-2 国内使用教程”。

要求:科技感、简洁、适合横向裁切、保留标题区域、主体清楚。

活动海报模板:

请生成一张 AI 绘图公开课活动海报,面向普通中文用户。

要求:主视觉醒目,整体专业但不生硬,保留标题区和报名信息区。

课程封面模板:

请生成一张线上课程封面图,主题是“零基础学会 AI 生成图片”。

要求:画面简洁,有学习感和科技感,适合知识付费平台展示。

专题页头图模板:

请生成一张 AI 产品专题页头图,突出多模型协作、图像生成和效率提升。

要求:简洁现代,适合后续叠加标题和按钮。

怎么判断结果是否真的可用

很多人会把“第一眼好看”当成唯一标准,但真实业务里不够。更稳的判断方法是看四件事:图是不是符合用途,主体是不是明确,是否有后续加字和排版空间,连续生成三次时质量是否稳定。只要其中两三项不成立,这张图就还只是“好看”,还没到“可用”。

复核一定要放到真实场景里做。文章头图就直接放进文章封面位测试,活动海报就叠标题试排版,PPT 配图就放进实际页面看协调度。这样你才能判断模型到底帮你省了时间,还是只是多了一轮视觉筛选工作。

常见问题

中文提示词可以吗

可以,而且对国内内容场景往往更方便。真正影响结果的不是中英文本身,而是你有没有把用途、受众、风格和验证标准说清楚。

第一张图不好看,是不是模型不行

不一定。第一张图主要是试方向,不是最终交付。更合理的做法是保留正确方向,连续修改两到三轮,再判断模板或平台是否适合你的任务。

什么时候切到备用入口

当主入口响应变慢、你需要做结果对照、发文节点比较紧,或者不想因为单一入口波动而停工时,就应该切到备用入口。最好的做法是提前把同一套模板在备用入口也跑一遍,确认切换成本可控。

结尾建议

如果你想把 gpt-image-2 国内使用 这件事真正落地,最实用的方式不是到处找零散入口,而是先把工作流建立起来。先用 AIMirror GPT 中文站 跑通“写需求、出图、改图、保存模板”这条主线,再把 chat.aicnbox.com 设为备用位。这样你不但能更快上手,也更容易把 AI 做图真正变成稳定生产工具。

如果你现在就想开始,建议先拿“公众号头图模板”试一轮,再按真实场景复核。只要你能稳定做出可用初稿,并把成熟提示词留存下来,gpt-image-2 对你来说就已经不是一个新鲜模型,而是一套能持续复用的中文做图工作流。

[^1]: OpenAI Developers 提供 `gpt-image-2` 模型文档,可用于核对模型命名和能力边界。OpenAI Developers(访问日期:2026-06-06)[^2]: OpenAI Developers 图像生成工具文档提供生成与编辑接口说明。Image Generation Tool Guide(访问日期:2026-06-06)